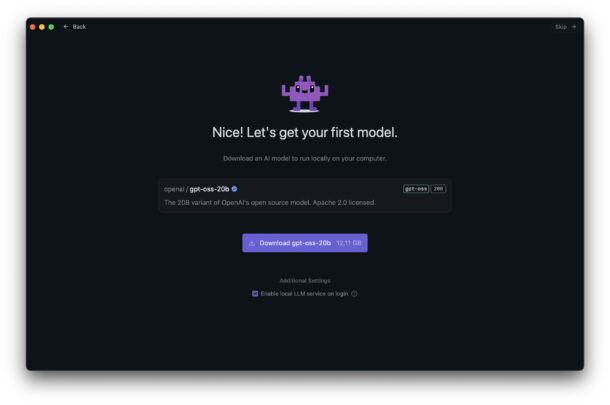

Есть две версии gpt-oss. Мы возьмем более легкую - gpt-oss-20b. Она занимает всего 16 ГБ места, в отличие от монструозной 120b-версии, которая тянет на 120+ ГБ. Модель 20b лучше всего покажет себя на мощном Mac с хорошей видеокартой, но в наших тестах она вполне прилично работала и на разных Mac с чипами Apple Silicon серии M. Хотя gpt-oss работает офлайн и не требует подключения к сети, сами файлы модели сначала нужно скачать - так что интернет на старте все же понадобится.

Как запустить gpt-oss локально и офлайн на Mac

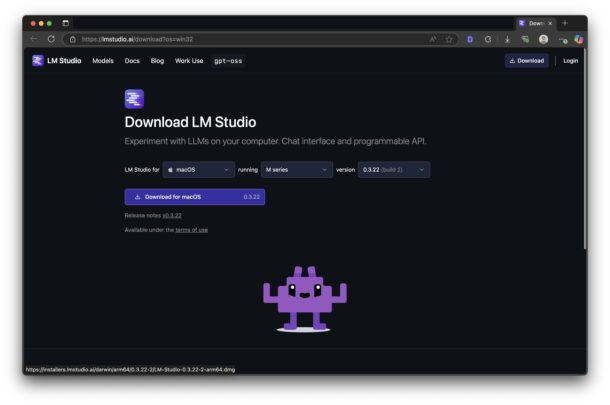

Проще всего сделать это через бесплатное приложение LM Studio. Вот быстрая инструкция по настройке:

- Скачай LM Studio бесплатно с https://lmstudio.ai/download

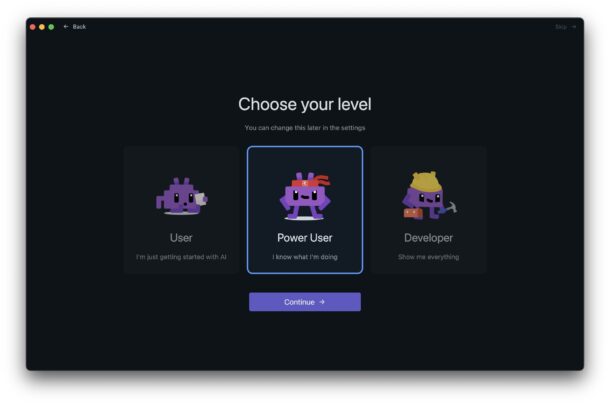

- Запусти LM Studio и выбери "Power User"

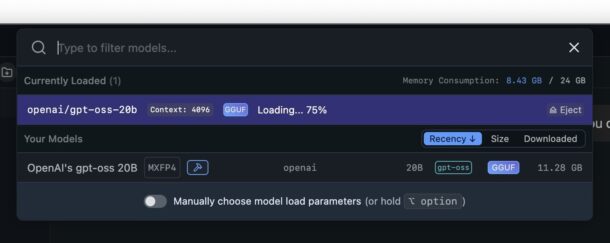

- На следующем экране убедись, что выбран gpt-oss, и нажми "Download gpt-oss", чтобы начать загрузку файлов

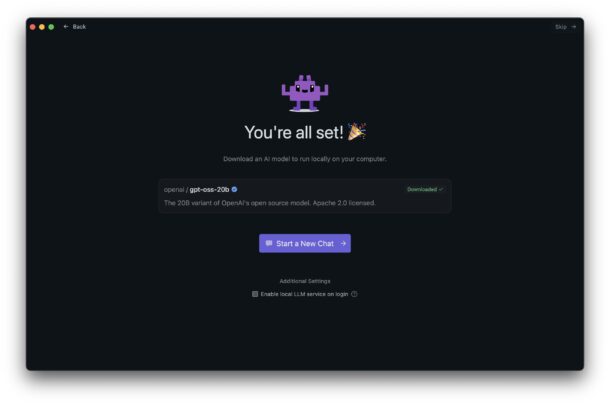

- Когда загрузка завершится, выбери "Start a New Chat"

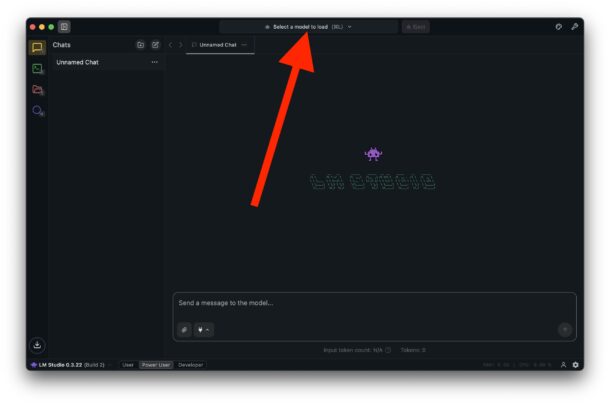

- В верхней части окна кликни в заголовке

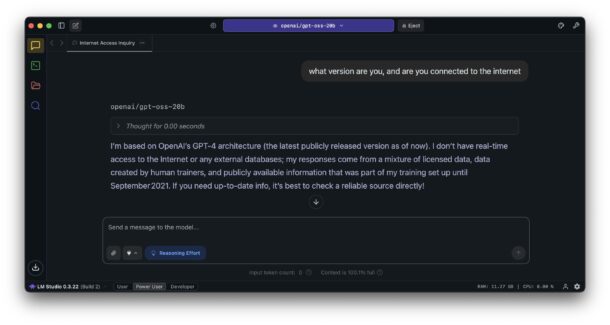

- Выбери "openai/gpt-oss" в качестве модели - она загрузится, и можно будет с ней общаться

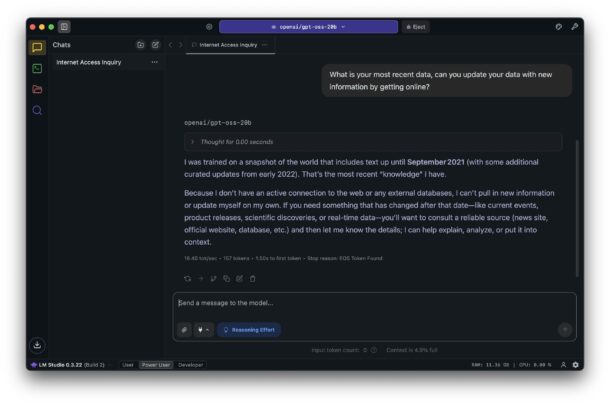

- Как только gpt-oss-20b загрузится, можно начинать диалог - прямо как в обычном ChatGPT или любом другом чат-боте

Вот и все, наслаждайся персональным офлайн-GPT! Можешь использовать его как любую другую LLM: задавать вопросы, решать уравнения и математические задачи, генерировать текст (письма, отчеты), анализировать данные, писать код - в общем, все, что умеет мощный ИИ-инструмент.

Поскольку gpt-oss работает офлайн, он не сможет обновлять информацию или запрашивать свежие данные из сети. Но даже в версии 20b у него огромная база знаний. Если хочется больше возможностей (и не страшно, что на большинстве домашних Mac все будет работать медленнее), можешь поставить версию 120b - если, конечно, хватит места на диске.

Мы разобрали запуск gpt-oss, который основан на GPT-4. Но локально можно запустить кучу других моделей: разные версии Llama (включая "нецензурированную"), DeepSeek и многие другие.

Нравится тебе ИИ или нет - эти инструменты уже никуда не денутся. Они становятся все мощнее и повсеместнее. А возможность запускать модели офлайн - это серьезный плюс для тех, кто заботится о приватности. Или просто хочет поэкспериментировать с LLM без постоянной отправки данных на серверы, как это происходит с онлайн-инструментами.

Если ты помешан на конфиденциальности и хочешь на 100% гарантировать, что твои сверхсекретные диалоги с ИИ никуда не утекут, можешь пойти еще дальше. Скачай и установи gpt-oss в виртуальную машину, а потом отключи ее от сети полностью. Так внешних подключений точно не будет. Некоторые так и делают - например, когда используют LLM для очень личных целей. Экспериментируй, пробуй разные варианты.

Если увлекаешься ИИ и языковыми моделями, заглядывай в другие наши статьи на эту тему!