Важное условие: для локального запуска нужен Mac на Apple Silicon. В этом руководстве мы воспользуемся бесплатной утилитой LM Studio — с её помощью настроить DeepSeek на Mac получится быстро. Звучит сложно? На самом деле, всё проще, чем кажется. Сейчас разберёмся по шагам.

Как запустить DeepSeek локально на Mac

Ещё раз: вам понадобится Mac на Apple Silicon с чипом серии M или новее. Требование строгое, но это стандарт для запуска любых локальных моделей — будь то Apple Intelligence, ChatGPT, Llama или другие популярные LLM. Также убедитесь, что на диске есть хотя бы 10 ГБ свободного места. Если у вас Mac на Intel, то локально DeepSeek не запустить, но остаются варианты с iPhone/iPad или веб-версией. А мы предполагаем, что Apple Silicon у вас уже есть. Итак, вот как запустить DeepSeek локально:

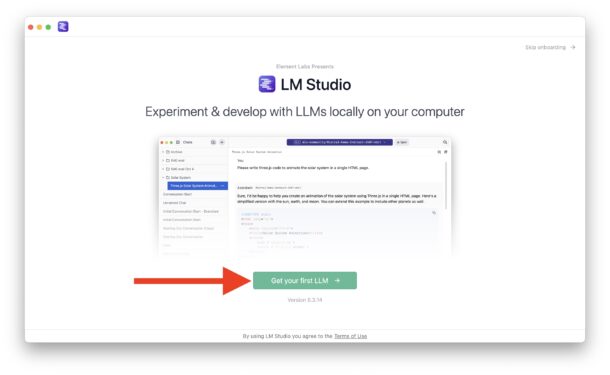

- Скачайте LM Studio бесплатно с lmstudio.ai

- Смонтируйте образ диска с LM Studio и перетащите приложение «LM Studio» из образа в папку «Программы», чтобы установить его. После этого запустите LM Studio прямо оттуда.

- При первом запуске вы увидите стартовый экран. Нажмите на зелёную кнопку «Get your first LLM».

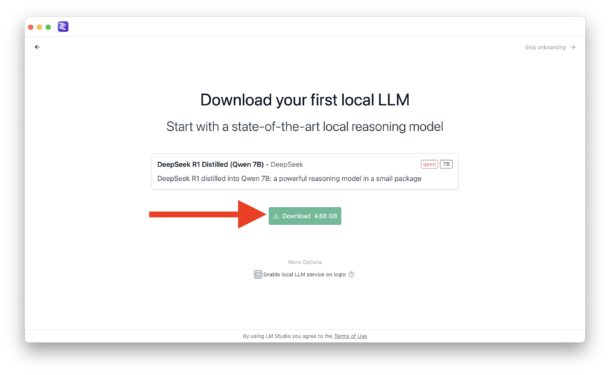

- На экране загрузки первой локальной модели нажмите зелёную кнопку «Download» (по желанию, снимите галочку с «Enable local LLM service on login», если не хотите, чтобы фоновый процесс для DeepSeek запускался при каждой загрузке системы).

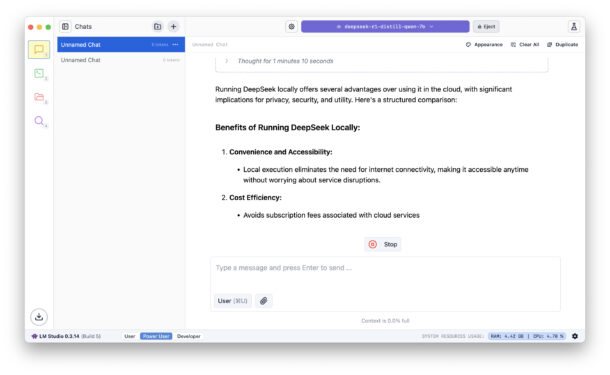

- Дождитесь загрузки DeepSeek LLM. Файл весит несколько гигабайт, так что это может занять время. Как только загрузка завершится, вы сможете общаться с моделью прямо на своём Mac.

Всё, теперь DeepSeek работает локально на вашем Mac, и вы можете свободно с ним взаимодействовать.

Хотите убедиться, что всё действительно работает офлайн? Отключите Wi-Fi или полностью разорвите интернет-соединение. Вы увидите, что LM Studio и DeepSeek по-прежнему отвечают.

Скорее всего, вы заметите, что локальный LLM работает медленнее, чем облачные аналоги. И это логично: у облачных сервисов — огромные мощности, заточенные исключительно под запуск моделей. А локальная модель упирается в ресурсы вашего Mac: процессор, память и текущую нагрузку. Если для вас в приоритете только скорость, то, возможно, облачный вариант будет предпочтительнее. Хотя на самых свежих и мощных Mac всё летает вполне прилично.

Кстати, через LM Studio на Mac можно запускать и другие LLM локально: помимо DeepSeek, там есть Llama, Mistral, Phi. Но сегодня мы, понятное дело, про DeepSeek. Раньше мы уже обсуждали варианты с локальными моделями, например, как запустить Llama LLM на Mac (включая нецензурированную версию!). Но этот способ запуска DeepSeek (да и других моделей, если интересно) — один из самых простых, да и производительность тут на уровне. За идею спасибо CultOfMac.

Лично я большой фанат Mac-клиента для ChatGPT, пользуюсь им постоянно. Но есть же ещё Perplexity и куча других интересных клиентов и ИИ-инструментов. Не говоря уже о десятках веб- и мобильных вариантов вроде Bing с ChatGPT, Google Gemini, Grok от X, Llama от Facebook и многих других.

А что вы думаете про локальный запуск DeepSeek на Mac? Как вообще относитесь к LLM и ИИ-инструментам? Есть любимая локальная модель или предпочтительный клиент? Делитесь мыслями и опытом по поводу DeepSeek, LLM и ИИ в целом в комментариях!